RAG 프롬프트 구성으로 LLM 환각 줄이는 핵심 가이드 TOP5

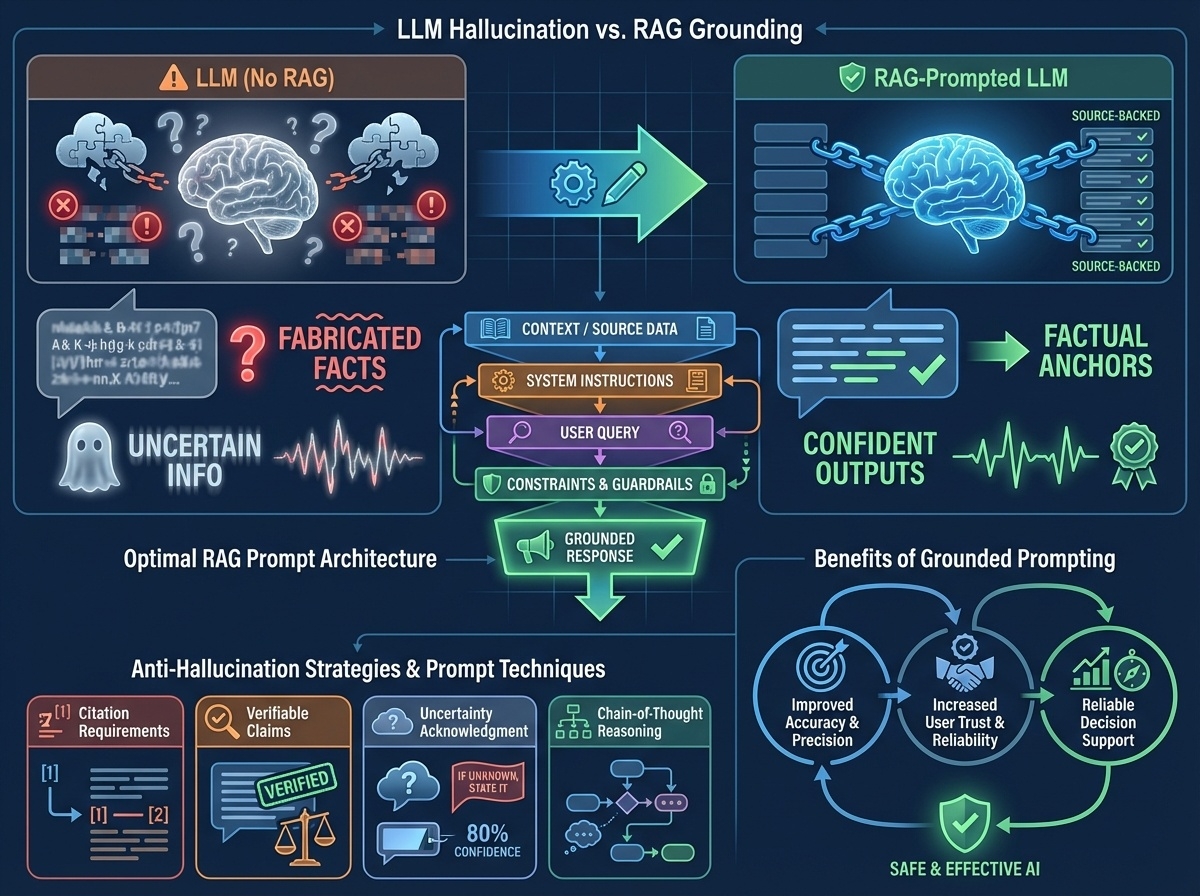

RAG 프롬프트 구성으로 LLM 환각 줄이는 핵심 가이드 TOP5에 대해 고민하고 계신 여러분, 안녕하세요! 인공지능 모델을 활용해 서비스를 개발하다 보면 가장 골치 아픈 문제가 바로 ‘환각(Hallucination)’ 현상일 것입니다. 모델이 마치 사실인 양 거짓 정보를 천연덕스럽게 이야기할 때마다 당혹스러웠던 경험, 한 번쯤 있으시죠? RAG(검색 증강 생성) 기술은 이러한 문제를 해결할 강력한 도구이지만, 단순히 데이터를 검색해서 던져주는 것만으로는 부족합니다. 핵심은 바로 검색된 데이터를 모델이 어떻게 받아들이고 처리할지 결정하는 ‘프롬프트’에 달려 있습니다. 오늘 이 글에서는 RAG 프롬프트 구성의 A to Z를 다루며, 신뢰할 수 있는 AI 응답을 만들어내는 실질적인 노하우 다섯 가지를 공유해 드리겠습니다.

가이드1. 명확한 역할 부여를 위한 템플릿 구조화

RAG 시스템의 마지막 관문인 생성 단계에서 가장 먼저 고려해야 할 요소는 바로 프롬프트 템플릿입니다. 대규모 언어 모델(LLM)은 매우 유연한 사고 능력을 갖추고 있지만, 우리가 원하는 방향으로 정확히 움직이게 하려면 잘 짜인 구조, 즉 틀이 필요합니다. 이를 위해 우리는 프롬프트 템플릿이라는 도구를 사용하여 모델에게 정보를 전달하는 방식을 표준화해야 합니다. 기본적으로 이 템플릿은 사용자가 입력한 질문({Question})과 검색 시스템이 찾아온 문맥 정보({Context})라는 두 가지 핵심 변수를 담을 그릇 역할을 하게 됩니다.

단순히 빈칸을 채우는 것을 넘어, 이 구조는 모델에게 ‘당신이 풀어야 할 문제는 이것이고, 참고해야 할 정답지는 바로 여기 있다’는 것을 명확히 구분해 주는 역할을 합니다. LangChain과 같은 프레임워크를 활용하면 이러한 변수들을 딕셔너리 형태로 관리하며 손쉽게 주입할 수 있습니다. 템플릿이 명확하게 구조화되어 있을 때, 모델은 자신의 머릿속에 있는 방대한 지식(내부 파라미터)보다 우리가 제공한 외부 지식(비정형 데이터)을 우선순위에 두고 처리하게 됩니다. 이것이 바로 RAG 프롬프트 구성의 첫 단추이자 가장 기본이 되는 원칙입니다.

하지만 템플릿의 형태가 정해져 있다고 해서 만사형통은 아닙니다. 템플릿 자체는 정적이지만, 그 안에 담기는 {Context}의 내용은 검색 결과에 따라 매번 달라지기 때문입니다. 따라서 우리는 모델이 이 가변적인 정보를 어떻게 해석해야 할지 아주 구체적인 지시를 내려야 합니다. 마치 신입 사원에게 업무 매뉴얼을 주듯이, 모델에게도 이 문맥을 어떻게 활용해야 하는지 친절하지만 단호하게 알려주는 과정이 필수적입니다. 이 과정이 제대로 선행되지 않으면 아무리 좋은 검색 엔진을 써도 엉뚱한 대답이 나올 수 있습니다.

가이드2. 환각을 막는 강력한 제약 조건 설정

RAG 시스템을 구축하는 가장 큰 이유는 모델의 거짓말, 즉 환각 현상을 억제하고 사실에 기반한 답변을 얻기 위함입니다. 이를 달성하기 위해 프롬프트 엔지니어링 단계에서 가장 신경 써야 할 부분은 바로 ‘지시문(Instruction)’의 강도입니다. 많은 분이 실수하는 부분이 모델에게 너무 부드럽게 부탁하는 것입니다. 예를 들어 “다음 정보를 참고해 주세요” 정도의 지시는 모델에게 “네가 아는 것도 섞어서 말해도 돼”라는 여지를 남기는 것과 같습니다.

따라서 우리는 문맥 제약(Constrained Generation)이라는 개념을 도입해야 합니다. 모델이 응답을 생성할 때 사용할 수 있는 정보의 출처를 오직 우리가 제공한 {Context}로만 한정 짓는 것입니다. 이를 위해서는 “오직(only)”, “엄격하게(strictly)”, “제공된 정보에만 근거하여(solely based on)”와 같은 강력하고 배타적인 단어를 사용해야 합니다. 지시문의 어조가 강하고 명확할수록 모델이 자신의 내부 지식을 섞어 쓰는 비율이 현저히 줄어듭니다.

[지시문 강도에 따른 효과 비교]

1. 약한 지시문 (비추천)

– 표현: “아래 내용을 참고해서 답변해 줘.”, “정보를 사용해서 대답해.”

– 결과: 모델이 내부 지식과 검색된 정보를 혼합하여 환각 발생 가능성 높음.2. 강한 지시문 (추천)

– 표현: “오직 제공된 문맥(Context)에만 근거하여 답변하세요.”, “문맥에 없는 내용은 절대 추가하지 마시오.”

– 결과: 모델이 제공된 데이터에만 의존하여 신뢰성 높은 답변 생성.

가이드3. 모르는 것은 모른다고 답하는 용기

세 번째 핵심 가이드는 바로 ‘실패 처리(Failure Handling)’에 대한 지침입니다. 일반적인 챗봇이라면 사용자의 질문에 어떻게든 대답하려고 노력하는 것이 미덕일 수 있습니다. 하지만 정확성이 생명인 엔터프라이즈 환경이나 전문적인 RAG 시스템에서는 다릅니다. 문맥 정보 속에 정답이 없다면, 억지로 말을 지어내는 것이 아니라 “모르겠습니다”라고 솔직하게 말하는 것이 오히려 시스템의 신뢰도를 높이는 길입니다.

프롬프트에 “만약 제공된 문맥에서 답을 찾을 수 없다면, ‘알 수 없음’이라고만 답하세요”라는 식의 부정 지시(Negative Instruction)를 반드시 포함해야 합니다. 더 나아가 불필요한 사과나 구구절절한 설명을 덧붙이지 못하게 “추가적인 설명은 하지 마시오”라고 못 박는 것도 좋은 방법입니다. 답을 모른다고 말하는 것은 시스템의 실패가 아니라, 우리가 설정한 제약 조건을 모델이 아주 잘 따르고 있다는 성공의 증거라는 점을 기억해 주세요. 2%의 환각도 허용하지 않는 엄격한 환경이라면 이러한 트레이드오프는 필수적입니다.

가이드4. 핵심 근거를 앞과 뒤에 배치

네 번째로 다룰 내용은 인간의 인지 능력과도 비슷한 LLM의 특성에 관한 것입니다. 최신 모델들은 수만 토큰에 달하는 긴 글을 읽을 수 있지만, 안타깝게도 모든 부분을 똑같은 집중력으로 읽지는 못합니다. 이를 ‘Lost in the Middle(중간에서 길 잃기)’ 현상이라고 부릅니다. 연구 결과에 따르면 모델들은 문맥의 시작 부분과 끝부분에 있는 정보에는 높은 주의(Attention)를 기울이지만, 중간에 끼어 있는 정보는 간과하거나 무시하는 경향이 있습니다. U자형 주의 편향을 보이기 때문입니다.

이것이 RAG 프롬프트 구성에서 시사하는 바는 매우 큽니다. 검색 엔진이 아무리 좋은 문서를 찾아왔더라도, 그 문서를 프롬프트의 중간쯤에 배치하면 모델이 이를 놓칠 수 있다는 뜻입니다. 단순히 검색된 문서 청크들을 순서대로 나열해서 {Context}에 넣는 방식은 비효율적일 수 있습니다. 따라서 우리는 모델이 중요한 정보를 놓치지 않도록 전략적으로 정보를 배치해야 합니다. 가장 관련성이 높고 중요한 증거가 되는 문서는 프롬프트의 최상단이나 최하단 같은 ‘특권적 위치’에 배치하는 것이 유리합니다.

리랭킹을 통한 핵심 정보 재배치 전략

그렇다면 중요한 정보를 어떻게 선별하여 좋은 위치에 배치할 수 있을까요? 여기서 필요한 기술이 바로 리랭킹(Reranking)입니다. 일반적인 검색 과정(1단계)에서는 속도가 빠른 모델을 사용해 후보군을 추리지만, 정확도가 다소 떨어질 수 있습니다. 이때 리랭커(Reranker)를 도입하여 2단계 정렬을 수행합니다. 리랭커는 사용자의 질문과 문서 간의 관계를 아주 정밀하게 분석하는 크로스 인코더(Cross-encoder) 방식을 주로 사용합니다.

리랭킹 과정을 거치면 검색된 문서들의 순위가 질문과의 관련성에 따라 재조정됩니다. 이렇게 선별된 가장 확실한 ‘증거’들을 {Context}의 가장 앞부분에 배치함으로써, LLM이 정답을 놓칠 확률을 획기적으로 줄일 수 있습니다. 이는 단순히 정보를 던져주는 것을 넘어, 모델이 밥상을 떠먹기 좋게 차려주는 것과 같습니다. 리랭킹은 노이즈를 제거하고 정보의 밀도를 높여주는 RAG 성능 최적화의 핵심 열쇠입니다.

가이드5. 검색 실패 시나리오에 대한 안전장치

마지막 다섯 번째 가이드는 검색 자체가 실패했을 때를 대비한 안전장치입니다. 사용자의 질문이 너무 특이하거나 데이터베이스에 관련 정보가 아예 없는 경우, 검색 엔진은 빈 결과값을 반환할 수 있습니다. 이때 {Context} 변수가 비어있거나 ‘None’ 상태가 되면, 일부 모델은 엉뚱하게도 자신의 사전 학습된 지식을 동원해 아무 말이나 지어내기 시작할 수 있습니다. 이는 우리가 가장 피하고 싶은 상황입니다.

이를 방지하기 위해 프롬프트 템플릿에는 명시적인 분기 처리가 필요합니다. 만약 검색 결과가 없다면 {Context} 자리에 “문서 정보 없음(No information found)”이라는 텍스트가 채워지도록 설계해야 합니다. 그리고 프롬프트 지시문에 “문서 섹션에 정보가 없으면 답변하지 마시오”라는 룰을 다시 한번 상기시켜야 합니다. 이 이중 안전장치가 있어야만 검색 파이프라인의 실패가 생성 단계의 환각으로 이어지는 연쇄 작용을 끊어낼 수 있습니다.

자주 묻는 질문 (FAQ)

Q1. RAG 프롬프트에서 가장 중요한 요소는 무엇인가요?

가장 중요한 것은 ‘문맥 제약’입니다. 모델이 외부 지식인 문맥(Context)에만 의존하여 답변하도록 강력한 지시어를 사용하는 것이 환각 방지의 핵심입니다. “오직(only)”과 같은 단어를 적극적으로 활용하세요.

Q2. 템플릿을 영어로 작성하는 것이 더 좋은가요?

일반적으로 최신 LLM들은 영어 데이터로 많이 학습되었기 때문에, 프롬프트 지시문을 영어로 작성했을 때 지시 이행 능력이 더 뛰어난 경우가 많습니다. 한국어 답변을 원하더라도 지시문(Instruction) 자체는 영어로 구성하는 것을 추천합니다.

Q3. ‘Lost in the Middle’ 현상이 무엇인가요?

LLM이 긴 텍스트를 처리할 때, 글의 시작과 끝부분 정보는 잘 기억하지만 중간 부분의 정보는 상대적으로 잘 인지하지 못하는 현상입니다. 이를 해결하기 위해 중요한 정보를 앞뒤에 배치하는 리랭킹 기술이 필요합니다.

Q4. 검색된 문서가 너무 많으면 다 넣어도 되나요?

무조건 많이 넣는 것이 능사는 아닙니다. 토큰 제한 문제도 있지만, 너무 많은 정보(노이즈)는 모델의 판단력을 흐리게 할 수 있습니다. 리랭킹을 통해 상위 K개의 고품질 문서만 선별하여 주입하는 것이 효율적입니다.

Q5. 모델이 자꾸 사과를 하거나 쓸데없는 말을 덧붙여요.

이는 프롬프트의 ‘부정 지시’가 약하기 때문입니다. “죄송합니다라는 말을 하지 마시오”, “추가 설명을 덧붙이지 마시오”와 같이 하지 말아야 할 행동을 구체적으로 명시하면 깔끔한 답변을 얻을 수 있습니다.

지금까지 에 대해 알아보았습니다. 프롬프트 템플릿의 구조화, 강력한 제약 조건 설정, 리랭킹을 통한 정보 배치 최적화 등은 모두 모델이 헷갈리지 않고 정확한 답을 내놓게 돕는 이정표와 같습니다. 아무리 뛰어난 AI 모델이라도 명확한 지시 없이는 길을 잃을 수 있습니다. 오늘 소개해 드린 팁들을 여러분의 서비스에 적용해 보신다면, 훨씬 더 똑똑하고 신뢰할 수 있는 AI 서비스를 만드실 수 있을 것입니다. 여러분의 성공적인 RAG 구축을 응원합니다.